Научиться правильно настраивать robots.txt и мета-тег robots имеет первостепенное значение для успеха в техническом SEO. Это краткое руководство поможет вам правильно это реализовать.

Meta Robots против Robots.txt

Прежде чем мы углубимся в основы того, что такое meta robots теги и robots.txt файлы, важно знать, что нет ни одной стороны, которая лучше другой использовалась бы в SEO.

Robots.txt файлы инструктируют сканеры обо всем сайте. В то время как теги meta robots проникают в суть конкретной страницы.

Мы предпочитаем использовать теги meta robots для многих вещей, в то время, как другие профессионалы SEO могут просто использовать простоту robots.txt файла.

Нет правильного или неправильного ответа. Это личное предпочтение, основанное на вашем опыте.

Что такое Robots.txt?

А robots.txt файл сообщает сканерам, что нужно сканировать. Это часть протокола исключения роботов (REP). Googlebot - это пример сканера.

Google использует Googlebot для обхода веб-сайтов и записи информации на этом сайте, чтобы понять, как ранжировать ваш сайт в результатах поиска Google.

Вы можете найти на любом сайте файл robots.txt, разместив /robots.txt в конце адреса домена:

www.mywebsite.com/robots.txt

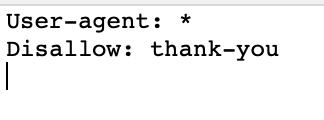

Вот как основной, robots.txt файл выглядит так:

User-agent: *

Disallow: /

Звездочка * после того user-agent сообщит сканерам, что robots.txt файл предназначен для всех ботов, которые приходят на сайт.

Косая черта / после “Disallow” говорит роботу не переходить ни на какие страницы сайта.

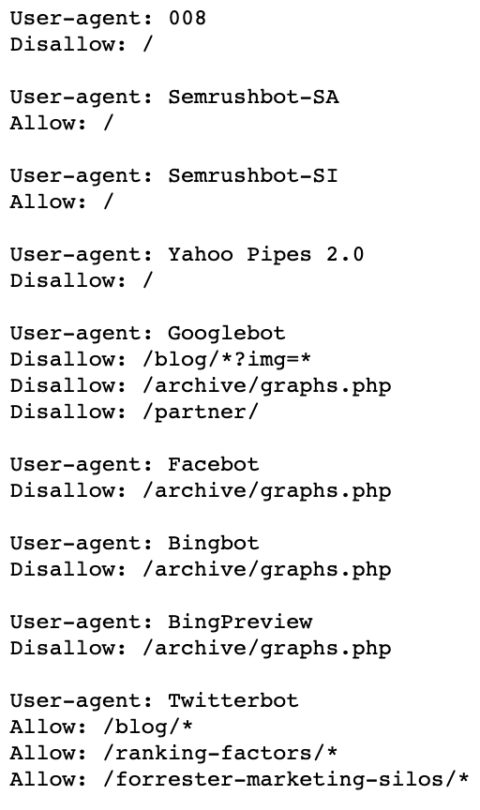

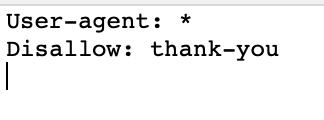

Вот пример robots.txt файла:

Вы можете видеть, что они сообщают сканерам, какие страницы сканировать, используя пользовательские агенты и директивы. МЫ погрузимся в них немного позже.

Почему Robots.txt важен?

Мы не можем сказать, сколько клиентов приходят к нам после миграции сайта или запуска нового сайта и спрашивают: почему мой сайт не занимает место после нескольких месяцев работы?

Можно сказать, что 60% причин в том, что robots.txt файл был обновлен неправильно.

Это означает, что ваш robots.txt файл по-прежнему выглядит так:

User-agent: *

Disallow: /

Такой robots.txt файл заблокирует все веб-сканеры, посещающие ваш сайт.

Еще одна причина, почему robots.txt так важен, это то, что у Google есть такая штука, как бюджет обхода.

Google заявляет:

“Googlebot создан для того, чтобы быть хорошим гражданином Интернета. Обход является его главным приоритетом,чтобы убедиться, что ничто не ухудшает опыт пользователей, посещающих сайт. Мы называем это “предел скорости обхода”, который ограничивает максимальную скорость выборки для данного сайта.

Проще говоря, это количество одновременных параллельных подключений, которые Googlebot может использовать для обхода сайта, а также время ожидания между выборками”.

Итак, если у вас есть большой сайт с некачественными страницами, которые вы не хотите, чтобы сканировались Google, вы можете сказать Google “Запретить” их через robots.txt файл.

Это снизит нагрузку на ваш сайт при обходе робота, и будут просканированы только высококачественные страницы, по которым вы хотите, чтобы Google оценил вас.

Нет жестких и быстрых правил для robots.txt файла...пока нет.

Google объявил о предложении в июле 2019 года начать внедрение определенных стандартов, но пока мы следуем лучшим практикам, которые делали в течение последних нескольких лет.

Robots.txt Основы

Как использовать Robots.txt

Использование robots.txt это жизненно важно для успеха СЕО.

Но, не понимая, как это работает, вы можете почесать голову, почему вы не оцениваете.

Поисковые системы будут сканировать и индексировать ваш сайт на основе того, что вы скажете им в robots.txt файле с использованием директив и выражений.

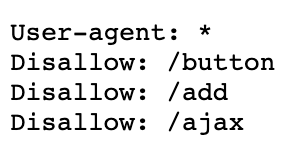

Ниже приведены общие robots.txt директивы, которые вы должны знать:

User-agent: * — Это первая строка в вашем robots.txt файл для объяснения сканерам правил того, что вы хотите, чтобы они сканировали на вашем сайте. Звездочка информирует всех пауков.

User-agent: Googlebot — это говорит только то, что вы хотите, чтобы паук Google сканировал.

Disallow: / — Это говорит всем сканерам не сканировать весь ваш сайт.

Allow: — Это говорит всем сканерам сканировать весь ваш сайт.

Disallow: /staging/ — это говорит всем сканерам игнорировать ваш промежуточный сайт.

Disallow: /ebooks/* .pdf — это говорит сканерам игнорировать все ваши форматы PDF, которые могут вызвать проблемы с дублированием контента.

User-agent: Googlebot

Disallow: /images/ — это говорит только Googlebot Crawler игнорировать все изображения на вашем сайте.

* — Это подстановочный знак, представляющий любую последовательность символов.

$ — используется для сопоставления конца URL-адреса.

Если в вашей CMS динамически не создаётся robots.txt файл, то, прежде чем вы начнёте его создавать сами, вот несколько основ, которые нужно запомнить:

- Отформатируйте свой robots.txt правильно. Вот правильная структура файла: User-agent → Disallow → Allow → Host → Sitemap. Она позволяет паукам поисковых систем получать доступ к категориям и веб-страницам в правильном порядке.

- Убедитесь, что каждый URL-адрес, который вы хотите Разрешить (Allow) или Запретить (Disallow), помещается в отдельную строку, как показано ниже, и не разделяется интервалом.

- Всегда используйте нижний регистр, чтобы назвать свой robots.txt.

- Не используйте никаких специальных символов, кроме * и $. Другие символы не распознаются.

- Создайте отдельный robots.txt файл для разных поддоменов. Например, hubspot.com и blog.hubspot.com - отдельные сайты, и оба имеют разные robots.txt файлы.

- Используйте #, чтобы оставлять комментарии в своем robots.txt файле. Сканеры не читают строки с символом #.

- Если страница запрещена в robots.txt файле по ссылке роботы не пройдут.

- Никогда не используйте robots.txt для защиты или блокирования конфиденциальных данных.

Что скрывать с помощью Robots.txt

Robots.txt файлы часто используются для исключения определенных каталогов, категорий или страниц из поисковой выдачи.

Вы можете исключить, используя директиву Запретить (Disallow).

Вот несколько общих страниц, которые мы скрываем с помощью robots.txt файла:

- Страницы с дублированным контентом (часто создаваемый для распечатывания)

- Пагинация страниц

- Динамические страницы продуктов и услуг

- Страницы учетной записи

- Страницы администратора

- Корзина

- Чаты

- Финальная страница корзины

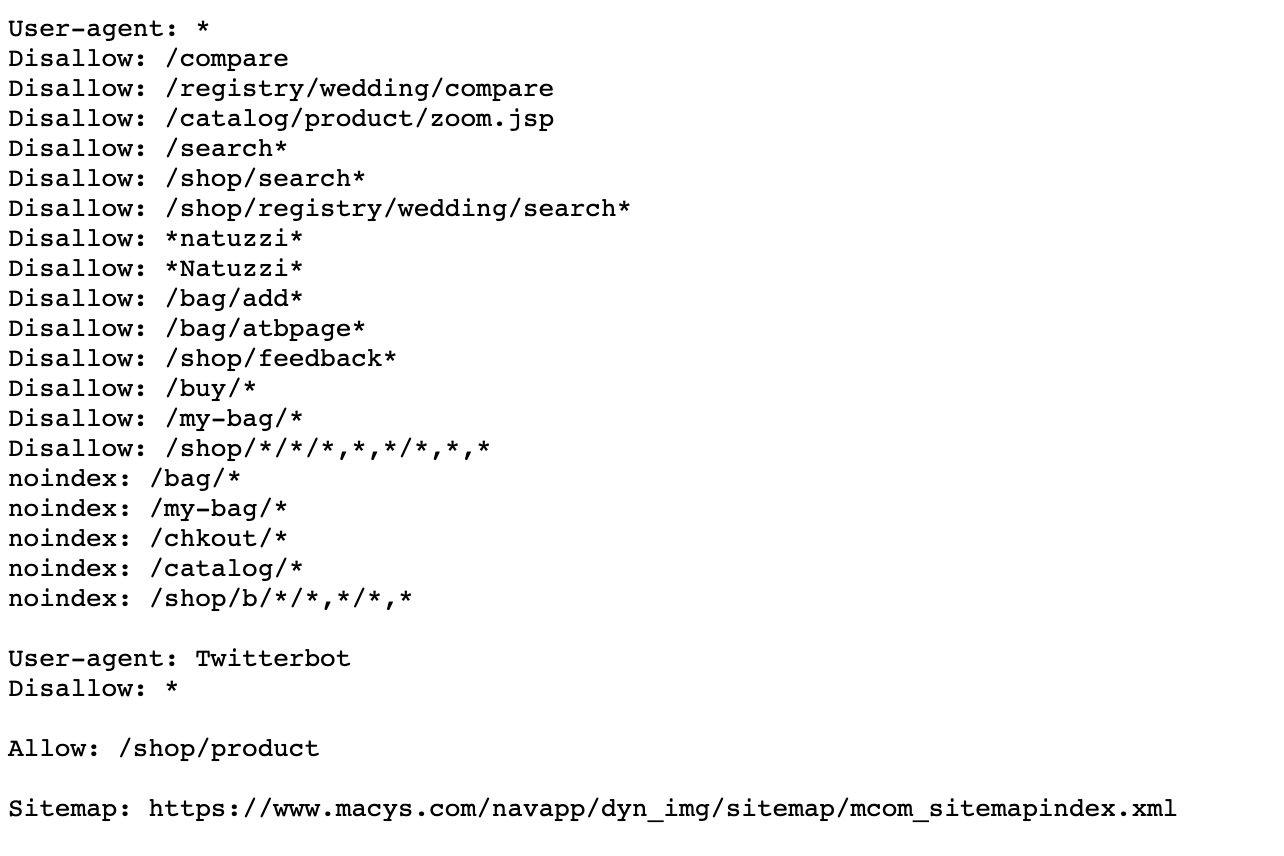

Это очень полезно для сайтов электронной коммерции, использующих параметры.

И вы можете увидеть здесь, как закрыть страницу благодарности.

Важно знать, что не все сканеры будут следовать вашему robots.txt файлу.

Плохие боты могут полностью игнорировать ваши robots.txt файл, поэтому убедитесь, что вы не храните конфиденциальные данные на заблокированных страницах.

Общие ошибки Robots.txt

Ошибка №1: имя файла содержит верхний регистр

Единственное возможное имя файла - robots.txt, ни Robots.txt или ROBOTS.TXT.

Придерживайтесь нижнего регистра, всегда, когда дело доходит до SEO.

Ошибка №2: Неразмещение robots.txt файла в корневом каталоге

Если вы хотите, чтобы ваш robots.txt файл моглли найти, поместите его в корневой каталог вашего сайта.

Неправильно

www.mysite.com/tshirts/robots.txt

Правильно

www.mysite.com/robots.txt

Ошибка №3: неправильно отформатированный User-Agent

Неправильно

Disallow: Googlebot

Правильно

User-agent: Googlebot

Disallow: /

Ошибка №4: упоминание нескольких каталогов в одной строке ‘Disallow’

Неправильно

Disallow: /css/ /cgi-bin/ /images/

Правильно

Disallow: /css/

Disallow: /cgi-bin/

Disallow: /images/

Ошибка №5: Пустая строка в ‘User-Agent’

Неправильно

User-agent:

Disallow:

Правильно

User-agent: *

Disallow:

Ошибка №6: зеркальные сайты и URL в директиве хоста

Будьте осторожны при упоминании директив "хост", чтобы поисковые системы поняли вас правильно:

Неправильно

User-agent: Googlebot

Disallow: /cgi-bin

Правильно

User-agent: Googlebot

Disallow: /cgi-bin

Host: www.site.com

Если ваш сайт имеет https, правильный вариант:

User-agent: Googlebot

Disallow: /cgi-bin

Host: https://www.site.com

Ошибка №7: перечисление всех файлов в каталоге

Неправильно

User-agent: *

Disallow: /pajamas/flannel.html

Disallow: /pajamas/corduroy.html

Disallow: /pajamas/cashmere.html

Правильно

User-agent: *

Disallow: /pajamas/

Disallow: /shorts/

Ошибка №8: Нет запрещенных инструкций

Инструкции disallow необходимы для того, чтобы поисковые роботы понимали ваши намерения.

Неправильно

User-agent: Googlebot

Host: www.mysite.com

Правильно

User-agent: Googlebot

Disallow:

Host: www.mysite.com

Ошибка №9: блокировка всего сайта

Неправильно

User-agent: Googlebot

Disallow: /

Правильно

User-agent: Googlebot

Disallow:

Ошибка №10: использование разных директив в разделе *

Неправильно

User-agent: *

Disallow: /css/

Host: www.example.com

Правильно

User-agent: *

Disallow: /css/

Ошибка №11: неправильный HTTP-заголовок

Неправильно

Content-Type: text/html

Правильно

Content-Type: text/plain

Ошибка №12: Нет карты сайта

Всегда размещайте карты сайтов в нижней части robots.txt файл.

Неправильно

Правильно

Ошибка №13: использование Noindex

В 2019 году Google объявила, что больше не признает директиву noindex, используемую в robots.txt файлах.

Итак, вместо этого используйте теги meta robots, о которых мы говорили выше.

Неправильно

Правильно

Ошибка №14: Запрет страницы в robots.txt файле, но все еще имеющей ссылки на неё

Если вы запретите страницу в robots.txt файл, Google все равно будет сканировать страницу, если у вас есть внутренние ссылки, указывающие на неё.

Вам нужно удалить эти ссылки, чтобы пауки полностью прекратили сканирование этой страницы.

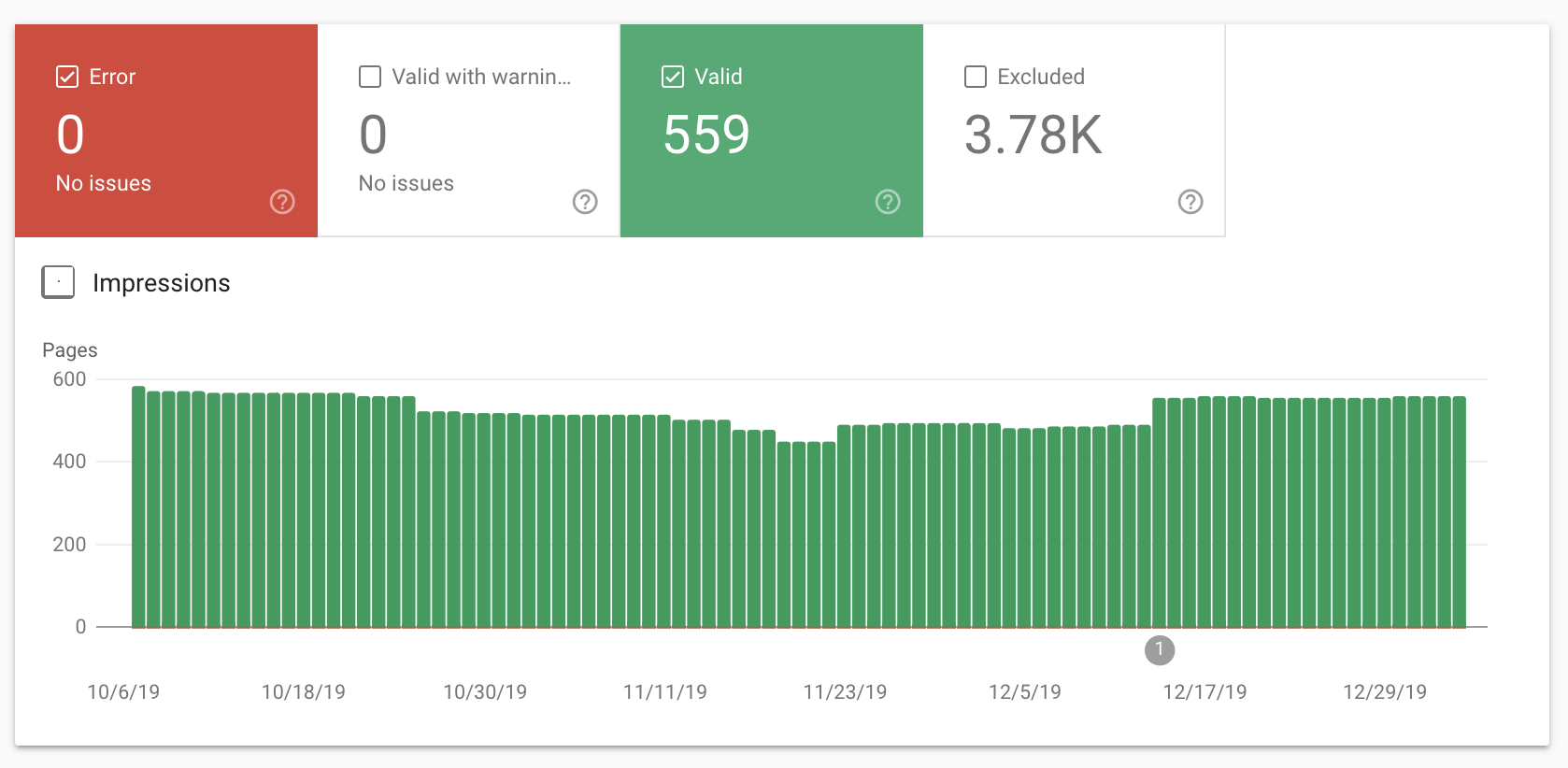

Если вы не уверены, можете проверить, какие страницы индексируются в отчете о покрытии Google Search Console. Воспользуйтесь Google robots.txt инструментом для тестирования.

Однако, если вы используете удобный для мобильных устройств тестовый инструмент Google, он не соответствует вашим правилам в robots.txt файл.

Что такое метатеги robots?

Теги Meta robots (также называемые директивами meta robots) - это фрагменты HTML-кода, которые сообщают поисковым роботам, как сканировать и индексировать страницы на вашем сайте.

Теги meta robots добавляются в раздел <head> веб-страницы.

Вот пример:

<meta name=”robots” content=”noindex” />

Теги meta robots состоят из двух частей.

Первая часть тега - name=’’.

Здесь вы идентифицируете агента пользователя. Например, “Googlebot”.

Вторая часть тега - content=’. Здесь вы говорите ботам, что вы хотите, чтобы они что-то делали.

Типы тегов Meta Robots

Теги Meta robots имеют два типа тегов:

- Тег Meta robots.

- X-роботы-метки.

Тип 1: Тег Meta Robots

Теги Meta robots обычно используются SEO-маркетологами.

Они позволяют указывать агентам пользователей (например, Googlebot) сканировать определенные области.

Вот пример:

<meta name=”googlebot” content=”noindex,nofollow”>

Этот тег meta robots говорит роботу Google Googlebot не индексировать страницу в поисковых системах и не переходить по обратным ссылкам.

Таким образом, эта страница не будет частью поисковой выдачи.

Я бы использовал этот тег meta robots для страницы благодарности.

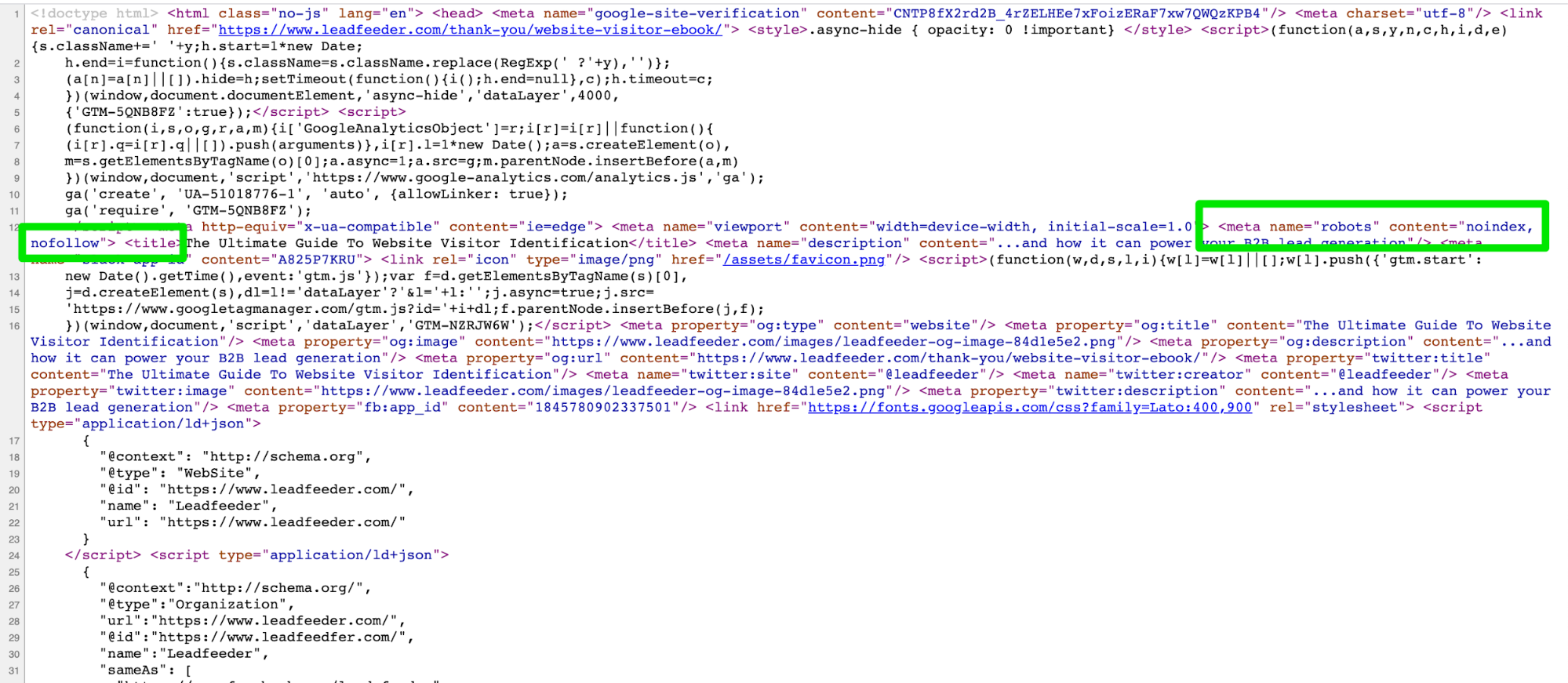

Вот пример страницы благодарности после загрузки электронной книги.

Теперь, если вы посмотрите на внутренний код, вы увидите, что он говорит noindex и nofollow.

Если вы используете разные директивы тегов meta robots для разных агентов поиска, вам нужно будет использовать отдельные теги для каждого бота.

Очень важно не размещать теги meta robots за пределами раздела <head>.

Тип 2: X-robots-tag

Тег x-robots позволяет делать то же самое, что и теги meta robots, но в заголовках HTTP-ответа.

По сути, это дает вам больше функциональности, чем теги meta robots.

Однако вам потребуется доступ к файлам .php, .htaccess или серверу.

Например, если вы хотите заблокировать изображение или видео, но не всю страницу, вместо этого следует использовать x-robots-tag.

Параметры тегов Meta Robots

Существует множество способов использования директив тегов meta robots в коде. Но, во-первых, вам нужно понять, что это за директивы и что они делают.

Вот разбивка директив тегов meta robots:

- all – Никаких ограничений по индексации и контенту. Эта директива используется по умолчанию. Это никак не влияет на работу поисковых систем. Мы использовали его, как короткий путь для индекса.

- index – Разрешить поисковым системам индексировать эту страницу в результатах поиска. Это значение по умолчанию. Вам не нужно добавлять это на свои страницы.

- noindex – Удаляет страницу из индекса поисковых систем и результатов поиска. Это означает, что поисковики не найдут ваш сайт или не перейдут по нему.

- follow – Позволяет поисковым системам следить за внутренними и внешними обратными ссылками на этой странице.

- nofollow– Запрещается переходить по внутренним и внешним обратным ссылкам. Это означает, что эти ссылки не будут проходить link equity.

- none – То же самое, что noindex и nofollow мета-теги.

- noarchive – Не показывайте ссылку ‘Сохраненная копия’ в результатах поиска.

- nosnippet – Не показывайте расширенную версию описания этой страницы в результатах поиска.

- notranslate – Не предлагайте перевод этой страницы в поисковой выдаче.

- noimageindex – Не индексируйте изображения на странице.

- unavailable_after: [RFC-850 date/time] – Не показывать эту страницу в результатах поиска после указанной даты/времени. Используйте формат RFC 850.

- max-snippet – устанавливает максимальное количество символов в мета-описании.

- max-video-preview - устанавливает количество секунд предварительного просмотра видео.

- max-image-preview – устанавливает максимальный размер предварительного просмотра изображения.

Иногда разные поисковые системы принимают разные параметры метатегов. Вот разбивка:

| Значение |

Google |

Bing |

Яндекс |

| index |

ДА |

ДА |

ДА |

| noindex |

ДА |

ДА |

ДА |

| none |

ДА |

Сомнение |

ДА |

| noimageindex |

ДА |

НЕТ |

НЕТ |

| follow |

ДА |

Сомнение |

ДА |

| nofollow |

ДА |

ДА |

ДА |

| noarchive |

ДА |

ДА |

ДА |

| nosnippet |

ДА |

НЕТ |

НЕТ |

| notranslate |

ДА |

НЕТ |

НЕТ |

| unavailable_after |

ДА |

НЕТ |

НЕТ |

Как использовать теги Meta Robots

Если вы используете сайт WordPress, есть много вариантов плагинов, чтобы адаптировать ваши мета-теги robots. Например, Yoast. Это универсальный SEO-плагин для WordPress, который предоставляет множество функций. Но есть также плагин Meta Tags Manager и плагин GA Meta Tags.

Независимо от того, на чем построен ваш сайт, вот три совета по использованию тегов meta robots:

- Держите его чувствительным к регистру. Поисковые системы распознают атрибуты, значения и параметры как в верхнем, так и в нижнем регистре. Мы рекомендуем вам придерживаться нижнего регистра, чтобы улучшить читаемость кода. Кроме того, если вы SEO-маркетолог, лучше всего привыкнуть использовать нижний регистр.

- Избегайте нескольких тегов <meta>. Использование нескольких метатегов приведет к конфликтам в коде. Используйте несколько значений в теге <meta>, например: <meta name=“robots” content=“noindex, nofollow”>.

- Не используйте конфликтующие мета-теги, чтобы избежать ошибок индексации. Например, если у вас есть несколько строк кода с такими мета-тегами, как этот <meta name=“robots” content=“follow”> и этот <meta name=“robots” content=“nofollow”>, будет учитываться только “nofollow”. Это потому, что роботы ставят ограничительные значения на первое место.

Robots.txt Теги Meta Robots работают вместе

Одна из самых больших ошибок, которые мы видим при работе на сайтах клиентов, - это когда robots.txt файл не соответствует тому, что вы указали в тегах meta robots. Например, robots.txt файл скрывает страницу от индексации, но теги meta robots делают обратное.

На пример из Leadfeeder, показанный выше, вы заметите, что эта страница благодарности запрещена в robots.txt файл и использованы теги meta robots noindex, nofollow.

По опыту, Google отдает приоритет тому, что запрещено в robots.txt файле.

Но вы можете устранить несоответствие между тегами meta robots и robots.txt, четко указав поисковым системам, какие страницы следует индексировать, а какие нет.

Заключение

Надеемся, что это руководство дало вам больше информации об основах robots.txt и мета-тегах.

Если у вас есть вопросы по статье или нужна помощь в создании сайта, пишите нам в чат на сайте или Вконтакте. Не забудьте оставить свой e-mail и мы ответим в самое ближайшее время.

Если у вас есть вопросы по статье или нужна помощь в создании сайта, пишите нам в чат на сайте или Вконтакте. Не забудьте оставить свой e-mail и мы ответим в самое ближайшее время.